如何在MongoDB中实现数据的网络爬虫功能

随着互联网的快速发展,网络爬虫成为了一项重要的技术,在大数据时代帮助我们快速搜集并分析海量数据。MongoDB作为一种非关系型数据库,在数据库的选择上具有一定的优势。本文将介绍如何在MongoDB中实现数据的网络爬虫功能,并提供具体的代码示例。

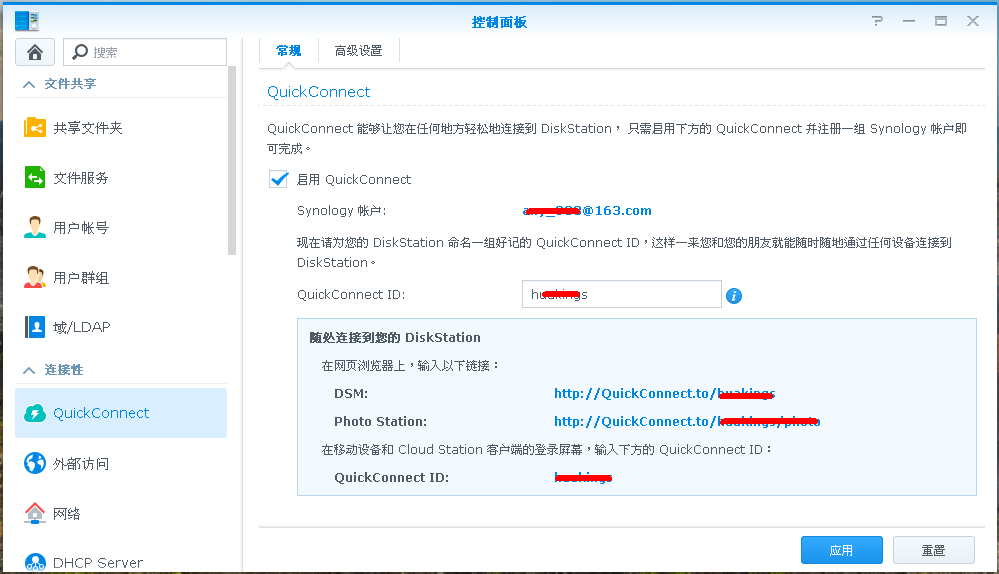

- 安装MongoDB和Python

在开始之前,我们需要先安装MongoDB和Python。可以从MongoDB官方网站(https://www.mongodb.com/)下载最新的MongoDB安装包,并参考官方文档进行安装。Python可以从官方网站(https://www.python.org/)下载最新的Python安装包并安装。 - 创建数据库和集合

在MongoDB中存储的数据被组织为数据库和集合的结构。首先,我们需要创建一个数据库,并在该数据库中创建一个集合以存储我们的数据。可以使用MongoDB的官方驱动程序pymongo来实现。

import pymongo

# 连接MongoDB数据库

client = pymongo.MongoClient('mongodb://localhost:27017/')

# 创建数据库

db = client['mydatabase']

# 创建集合

collection = db['mycollection']

- 实现网络爬虫

接下来,我们要实现一个网络爬虫,用于获取数据并将数据存储到MongoDB中。这里我们使用Python的requests库来发送HTTP请求,并使用BeautifulSoup库来解析HTML页面。

import requests

from bs4 import BeautifulSoup

# 请求URL

url = 'https://example.com'

# 发送HTTP请求

response = requests.get(url)

# 解析HTML页面

soup = BeautifulSoup(response.text, 'html.parser')

# 获取需要的数据

data = soup.find('h1').text

# 将数据存储到MongoDB中

collection.insert_one({'data': data})

- 查询数据

一旦数据存储到MongoDB中,我们可以使用MongoDB提供的查询功能来检索数据。

# 查询所有数据

cursor = collection.find()

for document in cursor:

print(document)

# 查询特定条件的数据

cursor = collection.find({'data': 'example'})

for document in cursor:

print(document)

- 更新数据和删除数据

除了查询数据,MongoDB还提供了更新数据和删除数据的功能。

# 更新数据

collection.update_one({'data': 'example'}, {'$set': {'data': 'new example'}})

# 删除数据

collection.delete_one({'data': 'new example'})

总结:

本文介绍了如何在MongoDB中实现数据的网络爬虫功能,并提供了具体的代码示例。通过这些示例,我们可以很方便地将爬取到的数据存储到MongoDB中,并通过MongoDB的丰富的查询和操作功能来进一步处理和分析数据。同时,我们还可以结合其他的Python库来实现更加复杂的网络爬虫功能,以满足不同的需求。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容